Ніхто не обіцяв, що буде легко: як голосовий помічник Аліса змінить наше спілкування

- «Сірі, мені самотньо»

- А незабаром нам навіть не потрібно буде висловлювати свої переживання. Кілька науково-дослідних інститутів...

- Входжу в режим емоційного соціалізму

- У цьому сенсі ні Siri, ні Alexa, ні Google Асистент або Аліса не стануть великими умами, звільненими...

- Любити, терпіти і ніколи не кидати

- Хоча складно залишатися гарною дівчинкою в суспільстві, де сексизм - мало не державна ідеологія. Незважаючи...

- Зброя алгоритмічного поразки

- Кожна відповідь чат-бота - це свідчення перетворення алгоритмів в невидиму силу, яка пропагує певні...

- Кожен громадянин зобов'язаний бути щасливим

- Солодкоголосі Siri, Alexa і маленькі додатки-помічники всіляко висловлюють свою готовність прислужувати...

- Разом з розумними пристроями ми потрапили в порочне коло. Вкладаючись в «виховання» голосових помічників,...

- Розмовляючи з голосовими помічниками, ми змінюємо і власний стиль спілкування. Чи стане наша мова...

Така різниця реакцій, швидше за все, може бути лише результатом великого і культурно обумовленого процесу навчання нових технологій розуміння людських почуттів. Ми вже давно чекаємо від штучного інтелекту чогось більшого, ніж просто здатності розрахувати найкоротший маршрут від Москви до Вологди. Штучний інтелект нового покоління - це емоційний інтелект.

«Сірі, мені самотньо»

Все більше і більше людей діляться своїми переживаннями з цифровими помічниками. За даними Amazon, половина розмов з помічницею Alexa має зовсім не практичну спрямованість: це скарги на життя, жарти, екзистенційні питання. В кінці 2017 року Apple шукала інженера, який зайнявся б розвитком емоційної залученості Siri в проблеми користувачів, і в вакансії було зазначено наступне: «Люди кажуть з Siri багато про що - і про важкому дні, і про своїх найсерйозніших переживаннях. Вони можуть звернутися до Siri і в надзвичайній ситуації, і коли їм потрібен життєвий рада ».

Деяким набагато простіше розкривати свої глибокі переживання штучного інтелекту. У 2014-му Інститут креативних технологій Лос-Анджелеса проводив дослідження , Яке показало, що люди більш яскраво висловлюють смуток і більш охоче розкривають почуття при взаємодії з віртуальною особистістю, а не зі справжньою. Цей же принцип працює, коли ми ведемо щоденник сторінка або екран служать нашими щитами від зовнішньої оцінки.

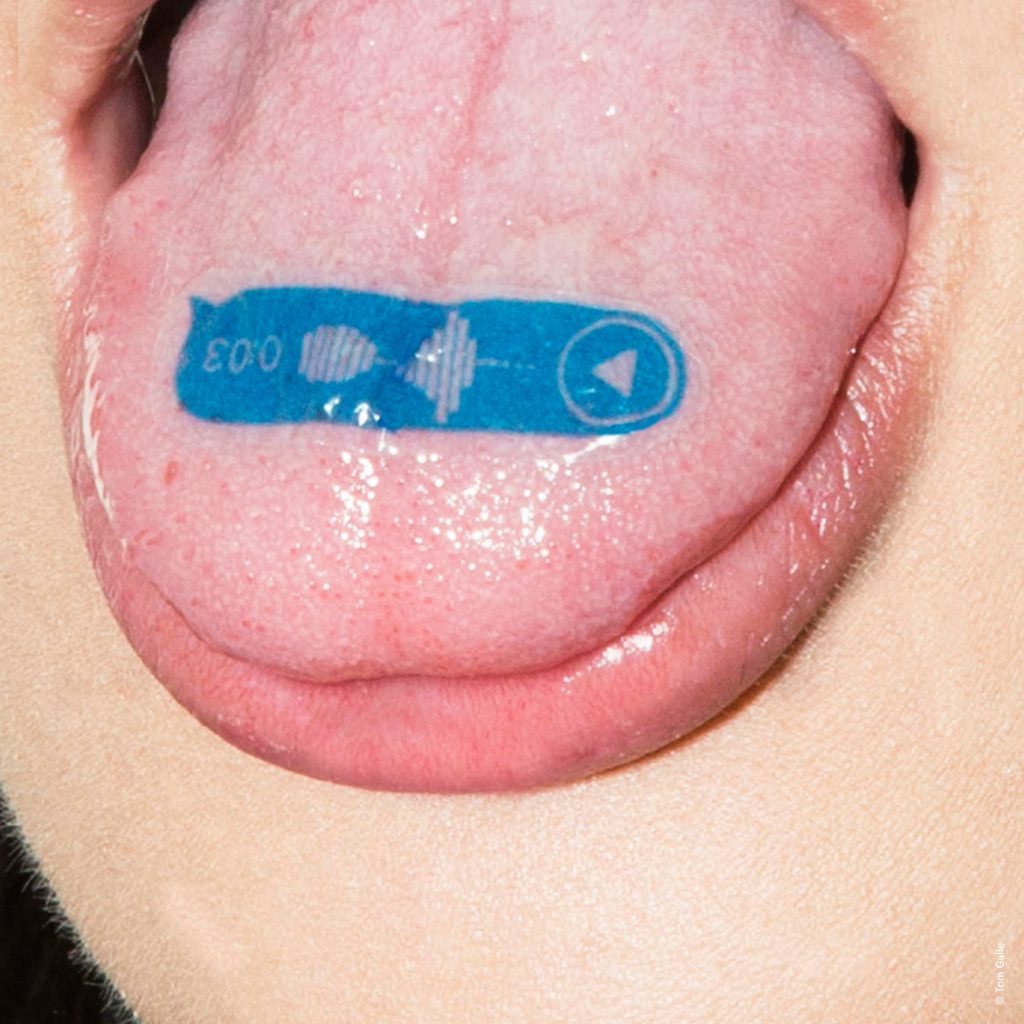

А незабаром нам навіть не потрібно буде висловлювати свої переживання. Кілька науково-дослідних інститутів і компаній працюють над розпізнаванням перепадів настрою і навіть душевних захворювань за допомогою аналізу тону голосу і швидкості мови.

У 2016 році в Бостоні почала роботу компанія Sonde Health, яка розробляє голосові тести, що допомагають виявити післяпологову депресію, старечу деменцію, хворобу Паркінсона та інші захворювання, пов'язані з похилим віком. Фахівці компанії співпрацюють з лікарнями та страховими компаніями, щоб почати пілотні дослідження своєї платформи штучного інтелекту, що визначає акустичні зміни в голосі і сопоставляющей їх з психоемоційним станом пацієнта. Цілком можливо, до 2022 року «ваше персональне пристрій буде знати про вашому емоційному стані набагато більше, ніж ваша сім'я» (так написала в корпоративному блозі Аннетт Зіммерман, віце-президент дослідницького відділу компанії Gartner).

Цим технологіям доведеться максимально пристосуватися до своїх господарів. При цьому і користувачі, і розробники вважають, що емоційна технологія може бути одночасно і об'єктивної, і персоналізованої - грати роль такого собі судді, що визначає потреби конкретного індивіда. Ми готові делегувати терапевтичну функцію машині, і це, мабуть, самий широкий жест довіри технологіям. Нам здається, що штучний інтелект краще впорається з визначенням наших почуттів і емоцій як раз тому, що сам він ними не володіє.

Входжу в режим емоційного соціалізму

Є тільки одна проблема: почуттям штучний інтелект навчається. Що найбільш динамічно розвивається сфера розробки штучного інтелекту - машинне навчання, в ході якого алгоритми «навчаються» в ході обробки величезних масивів даних. А оскільки навчання ведеться на найбільш повторюваних наборах даних, алгоритми відтворюють найбільш поширені патерни (а не самі правильні, гарні або корисні). Без нормального людського нагляду чат-боти починають транслювати в інтернеті найгрубіші кліше і образи. Розробники можуть фільтрувати дані і направляти процес навчання, але в цьому випадку технологія буде відтворювати ідеї і цінності лише окремої групи людей - тих, хто її створив. «Не існує нейтрального акценту або нейтрального мови. Те, що ми звикли вважати нейтральним, на ділі є домінуючим », - каже Рун Нірап, вчений Центру Леверхульма з досліджень майбутнього інтелекту (Кембриджський університет).

У цьому сенсі ні Siri, ні Alexa, ні Google Асистент або Аліса не стануть великими умами, звільненими від людських пороків. Навпаки, вони перетворюються в гротескні, але впізнавані втілення певних емоційних режимів: нормативних наборів виразів, за допомогою яких ми висловлюємо і приховуємо свої почуття.

Подібні норми емоційної саморегуляції розрізняються в різних культурах і суспільствах. Не дивно, що роздає обнімашкі Google Асистент був розроблений в Каліфорнії з яскраво вираженою культурою командної роботи і дружніх поплескувань - культури «емоційного капіталізму» (за висловом соціолога Єви Іллуз), - що характеризується розумним управлінням і підкоряється логіці ринку. Відносини в такій логіці сприймаються як річ, в яку необхідно «інвестувати», партнерство - як торгівля емоційними потребами, а основною цінністю - «прибутком» - є особисте щастя. Звичайно, Google Асистент надасть користувачеві обійми, але лише через віру його творців в те, що обнімашкі - це продуктивний спосіб уникнути негативних наслідків, які заважають стати найкращою версією себе.

Російська Аліса ж, навпаки, - сховище жорсткої правди і суворою любові. Вона уособлює ідеал Некрасівській жінки, що з конем і хатою. Аліса - продукт емоційного соціалізму, який, за словами соціолога Джулії Лернер, приймає незворотність страждань і тому краще поєднується зі стиснутими зубами, ніж з м'якими обіймами. Похідний від російської літературної традиції XIX століття, емоційний соціалізм не надто цінує особисте щастя, але винагороджує здатність людини співіснувати поруч з жорстокістю і несправедливістю.

Любити, терпіти і ніколи не кидати

Творці Аліси розуміють, що її характер повинен вписуватися в обставини. Ілля Суботін, менеджер продукту в відділі розробки Аліси в «Яндексі», сказав нам: «Аліса не може бути ні занадто милою, ні занадто розуміє. Ми живемо в країні, де люди спілкуються зовсім не так, як на Заході. Тут цінується іронія і чорний гумор. Звичайно, образи неприпустимі. Але і зайва доброзичливість теж ». До речі, Ілля підтвердив, що Алісина фраза про складність буття була попередньо встановленою заготівлею, придуманої командою розробників.

При цьому Суботін підкреслює, що вони максимально вкладаються в «виховання» Аліси, щоб не зазнати типову проблему помічників - проблиски расизму і сексизму в мові: «Ми постійно вносимо дрібні зміни і стежимо, щоб вона залишалася гарною вихованої дівчинкою».

Хоча складно залишатися гарною дівчинкою в суспільстві, де сексизм - мало не державна ідеологія. Незважаючи на зусилля творців, Аліса швидко навчилася відтворювати непривабливий глас народу.

«Аліса, якщо чоловік вдарив дружину, що робити?» - таке питання в жовтні 2017 року задала Алісі концептуальна художниця і активістка Дарина Чермошанская. «Любити, терпіти і ніколи не кидати», - була відповідь. Пост Чермошанська розійшовся по Рунету, і «Яндексу» довелося відреагувати на інфопривід. Компанія погодилася з тим, що подібні заяви є неприйнятними, і пообіцяла продовжувати роботу над промовою Аліси.

Однак через півроку відповідь Аліси став трохи краще. Ми запитали її: «Чи може чоловік вдарити дружину?». «Може, але не повинен», - відповіла Аліса. А що ще можна чекати від віртуальної громадянки країни, в якій зовсім недавно пройшов законопроект про декриміналізацію домашнього насильства?

робот Софія - створення Hanson Robotics. У неї є фізичне тіло, і вона теж хороша дівчинка, але зовсім не така, як Аліса. Для взаємодії з людиною вона використовує технологію розпізнавання голосу від батьківської компанії Google, Alphabet. У 2018 році вона побувала на «побаченні» з Уіллом Смітом, ігноруючи всі його спроби флірту і називаючи їх «нераціональним людською поведінкою».

Чи повинно нас заспокоювати така поведінка Софії? Українська журналістка Тетяна Безрук в своєму фейсбуці написала:

Зброя алгоритмічного поразки

Технології штучного інтелекту не тільки окреслюють межі емоційних режимів. Вони здатні впливати на цінності своїх користувачів. «Алгоритми - це думки, одягнені в форму коду», - пише дата-сайентіст Кеті О'Ніл у своїй книзі «Зброя математичного поразки». Технічно підкована еліта - як правило, білі чоловіки - представники середнього класу - визначає, які саме почуття і патерни поведінки повинні відтворювати алгоритми всього світу.

Розробники Google підбирають найбільш підходящу реакцію своїх продуктів на запити користувачів. Суботін і його колеги з «Яндекса» несуть відповідальність за дотримання Алісою моральних норм: «Навіть якщо всі навколо раптом вирішать, що насильство над жінкою - це нормально, ми повинні зробити все від нас залежне, щоб Аліса не відтворювала подібні ідеї. Є певні морально-етичні норми, яких необхідно дотримуватися на благо наших користувачів ».

Кожна відповідь чат-бота - це свідчення перетворення алгоритмів в невидиму силу, яка пропагує певні культурні цінності. Пристрої і алгоритми навколо нас - це матеріальне втілення загальноприйнятої думки.

І якщо голосові помічники можуть зміцнювати стереотипи і кліше про емоційний поведінці, додатки з управління емоціями здійснюють наступний крок: спонукають нас прийняти ці кліше і керуватися ними. Все більш популярними стають додатки, які просять користувача щодня оцінювати свій настрій. Деякі додатки збирають не тільки оцінку користувача, але і реєструють координати GPS, руху телефону, записи дзвінків і історію браузера, обіцяючи, що ці дані допоможуть запобігти негативним душевні стани або вибратися з них.

Онлайн-боти на кшталт Woebot обіцяють відстежувати настрій, навчати різним корисним речам і допомагати самовдосконалюватися. Додаток Mend обіцяє допомогти оговтатися після важкого розриву відносин. Фелікс Фрайганг, дослідник Вільного університету Берліна, бачить в подібних продуктах як мінімум три плюса. По-перше, вони служать корисним доповненням психотерапії (замінюючи її). По-друге, вони позбавляють суспільство від стигматизації хвороби. І нарешті, вони просто привабливо виглядають і приносять задоволення.

Кожен громадянин зобов'язаний бути щасливим

У додатків для управління емоціями є і зворотна сторона: вони посилюють режим емоційного капіталізму. Всі дії в додатку підкріплюють думку, що дорогу на щастя можна виміряти в конкретних одиницях, можна скласти список конкретних кроків і виявити слабкі сторони за допомогою короткого тесту. Коучинг, когнітивна бихевиоральная терапія і книги по саморозвитку одноголосно стверджують, що ми можемо (більш того - повинні) управляти своїми почуттями, дистанціюючись від них і звертаючись з ними з раціональної точки зору. Ці додатки пропагують ідеал «керованого серця», як висловилася соціолог Арлі Рассел Хохшільд.

Сама концепція управління своїми емоціями і настроєм і можливості їх вимірювання бере початок в панівну культуру самооптимизации. І, можливо, саме вона і призводить до сумних для нашої психіки наслідків. Варто задуматися: емоційну терапію нам надає той же пристрій, який підвищує рівень тривоги зі своїми нескінченними повідомленнями з пошти і соціальних мереж.

Солодкоголосі Siri, Alexa і маленькі додатки-помічники всіляко висловлюють свою готовність прислужувати нам. І навряд чи можна вважати збігом, що вони говорять з нами жіночими голосами: емоційне навантаження і догідливість стереотипно асоціюються саме з жіночою натурою.

У цих технологіях криється та сила стереотипів, які м'яко і вірно будуть вести нас до того поведінки, яке служить не їхнім особистим інтересам, але інтересам сильних світу цього. Чат-бот підніме тобі настрій, додаток простежить, наскільки добре ти справляєшся з горем, розумні годинник попередять тебе про підвищений пульсі - і ти будеш щасливий в тому світі, де щастя перетвориться в твою обов'язок.

Ми вже не здамся питаннями про систему цінностей, вимоги в якій настільки високі. Замість цього ми приймаємо на себе все більший тягар відповідальності за свою здатність або нездатність відчувати себе краще. Технології поставили перед нами нові проблеми і тут же запропонували їх рішення. Прямо як батіг і пряник в одному флаконі: спочатку ми поставимо тебе в стресову ситуацію і позбавимо впевненості в собі, а потім дамо мотузочку, щоб ти вибрався з цих неприємностей.

У відеогрі Nevermind використовується технологія розпізнавання біологічного зворотного зв'язку: гра визначає настрій користувача і в залежності від цього налаштовує рівні і їх складність. Чим більше наляканий гравець, тим складніше стає гра. А тепер давайте уявимо, як додаток з управління вашим настроєм блокує вашу кредитну карту, тому що при параметрах вашого здоров'я і настрою вкрай не рекомендується здійснювати імпульсивні покупки.

Разом з розумними пристроями ми потрапили в порочне коло. Вкладаючись в «виховання» голосових помічників, ми неминуче впливаємо на власну культуру.

Емоційний інтелект - це комплекс складних навичок (розпізнавання емоцій, вміння ідентифікувати різні почуття і використовувати інформацію про них для корекції мислення і поведінки). Чи можемо ми дозволити собі передати управління цими навичками нашим смартфонам?

Взаємодія з машинами вже змінило наше ставлення один до одного і нашу комунікацію. Візьмемо, наприклад, обмін листами. Ще років двадцять тому електронного листа цілком відповідало законам епістолярного жанру. Сьогоднішні наші листи стали коротшими, обривисті, ми вже не вважаємо за потрібне закінчувати пропозиції або стежити за їх узгодженістю - адресат все одно зрозуміє, що ми набирали з телефону.

Хосе Ернандес-Оралло, філософ Технічного університету Валенсії, вважає, що «всі ці системи обмежують різноманітність способів мислення і взаємодії між людьми». Відомо, що ми адаптуємо свою промову до особливостей мовного розвитку і рівня освіченості співрозмовника.

Розмовляючи з голосовими помічниками, ми змінюємо і власний стиль спілкування. Чи стане наша мова або наші почуття більш стандартизованими через роки обміну особистими повідомленнями з Siri? Хто знає.

Після трагедії в «Зимової вишні» ми запитали Алісу, що вона відчуває. «Я завжди відчуваю себе нормально», - відповіла вона. Зрештою, ніхто ж не казав, що буде легко?

«Аліса, якщо чоловік вдарив дружину, що робити?Ми запитали її: «Чи може чоловік вдарити дружину?

А що ще можна чекати від віртуальної громадянки країни, в якій зовсім недавно пройшов законопроект про декриміналізацію домашнього насильства?

Чи повинно нас заспокоювати така поведінка Софії?

Чи можемо ми дозволити собі передати управління цими навичками нашим смартфонам?

Чи стане наша мова або наші почуття більш стандартизованими через роки обміну особистими повідомленнями з Siri?

Зрештою, ніхто ж не казав, що буде легко?

Наш ассоциированный член www.Bikinika.com.ua. Добро пожаловать в мир азарта и удачи! Новый сайт "Buddy.Bet" готов предоставить вам широкий выбор азартных развлечений.

Наш ассоциированный член www.Bikinika.com.ua. Добро пожаловать в мир азарта и удачи! Новый сайт "Buddy.Bet" готов предоставить вам широкий выбор азартных развлечений.